Durante el último año, la élite de los modelos abiertos de programación asistida, al menos en puntos de referencia como SWE-Bench verificadoha hablado con acento chino. Nombres como DeepSeek, Kimi o Qwen se habían consolidado en las posiciones más altas en las pruebas y marcaban el ritmo en tareas complejas de ingeniería de software, mientras Europa todavía buscaba su posición. la llegada de Devstral 2 altera esa distribución. No desplaza a quienes ya estaban en lo más alto, pero sitúa a Mistral al mismo nivel de exigencia y convierte a una empresa europea en un verdadero competidor en un campo que hasta ahora parecía reservado a otros.

Cambio de liga: el salto técnico que se venía gestando desde hace tiempo. Durante los últimos meses, los modelos abiertos desarrollados en Europa y Estados Unidos habían mostrado una constante evolución, aunque todavía sin las prestaciones necesarias para competir en las pruebas más exigentes. El progreso fue evidente, pero faltaba un proyecto capaz de consolidarlo a un nivel superior y demostrar que este camino podría dar resultados comparables a los del sector.

Devstral 2 en datos: rendimiento, tamaño y licencias. El nuevo modelo Mistral alcanza 123B de parámetros en una arquitectura densa y ofrece un contexto ampliado de 256K tokens, acompañado de una licencia MIT modificada que facilita su adopción en entornos abiertos. Su versión compacta, Devstral Small 2, reduce el modelo a 24B de parámetros licenciados Apache 2.0. En las cifras SWE-Bench Verified publicadas por la empresaDevstral 2 obtiene un 72,2%, una nota que lo sitúa en el apartado más competitivo de los modelos abiertos evaluados y que confirma su presencia entre las alternativas más avanzadas del segmento.

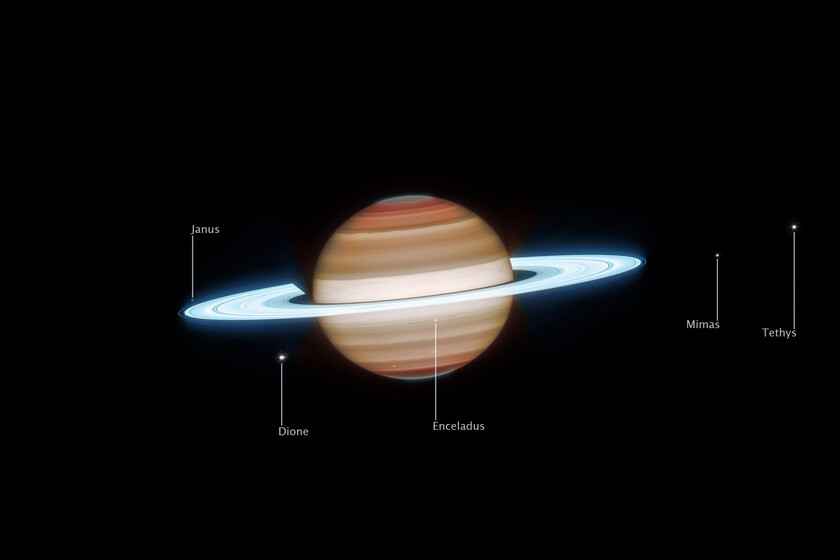

Se refleja en un panorama concentrado en la parte superior del punto de referencia. Entre los modelos abiertos, DeepSeek V3.2 lidera el grupo con un 73,1%, seguido de Kimi K2 Thinking con un 71,3% y propuestas como Qwen 3 Coder Plus y Minimax M2, que rondan los 69 puntos. En niveles inferiores aparecen GLM 4.6, GPT-OSS-120B, CWM y DeepSWE, con resultados más moderados. En el apartado comercial cerrado (modelos propietarios), la gráfica incorpora puntuaciones superiores: Gemini 3 Pro alcanza un 76,2%, GPT 5.1 Codex Max sube hasta un 77,9% y Claude Sonnet 4,5 firma un 77,2%, todos ellos por encima de las mejores notas registradas por los modelos abiertos.

Lo que realmente mide SWE-Bench Verified y por qué es importante. SWE-Bench Verified es una prueba diseñada para evaluar si un modelo puede resolver tareas de programación reales, no ejercicios sintéticos. Cada caso presenta un error en un repositorio de código abierto y requiere un parche para pasar las pruebas fallidas anteriormente. La evaluación busca medir si el sistema comprende la estructura del proyecto, identifica la causa del problema y propone una solución coherente. Es una métrica útil y exigente, aunque limitada a repositorios de Python y a un conjunto específico de situaciones que no cubren toda la amplitud del trabajo del software.

De copilotos a agentes que actúan en el proyecto. La llegada de Devstral 2 coincide con un cambio más amplio en la forma de trabajar con las herramientas de programación. Ya no se trata sólo de recibir sugerencias en el editor, sino de contar con agentes capaces de explorar todo un repositorio, interpretar su estructura y proponer cambios acordes con su estado real. En este contexto aparece Vibe CLI, una herramienta que permite a Devstral analizar archivos, modificar partes del código y ejecutar acciones directamente desde el terminal, acercando estas capacidades al flujo de trabajo diario de los desarrolladores.

Coste y despliegue: qué puede hacer cada tipo de usuario con Devstral. El modelo estará disponible de forma gratuita durante un período inicial y luego costará $0,40 por millón de tokens para entrada y $2,00 por millón para salida, mientras que la versión Small 2 tendrá un precio más bajo. Su implementación también marca la diferencia: Devstral 2 requiere al menos cuatro GPU de clase H100, destinadas a centros de datos, mientras que Devstral Small 2 está pensado para ejecutarse en una sola GPU y, según la documentación de Mistral, la familia Devstral Small también puede ejecutarse en configuraciones de solo CPU, sin una GPU dedicada. Esta variedad permite tanto a empresas como a desarrolladores individuales encontrar un punto de entrada adecuado.

La aparición de Devstral 2 introduce un elemento inesperado en un espacio donde las empresas chinas marcan el ritmo y donde ni siquiera Estados Unidos, pese a su liderazgo en inteligencia artificial, contaba con un modelo abierto en esta gama de altas prestaciones en SWE-Bench Verified. Mistral no desplaza a quienes ya estaban en lo más alto, pero sí amplía la conversación y demuestra que Europa puede competir en un terreno en el que no aparecía hasta ahora. Es un movimiento que no altera la jerarquía general, aunque sí abre un nuevo margen para la evolución de las herramientas de programación asistida.

Imágenes | con Géminis 3

En | OpenAI y Google niegan que vayan a poner anuncios en ChatGPT y Gemini. La realidad es que las cuentas no vienen solo con suscripciones