¿Qué habrá cuando la IA termine la humanidad? – Tinta clara

- junio 22, 2025

- 0

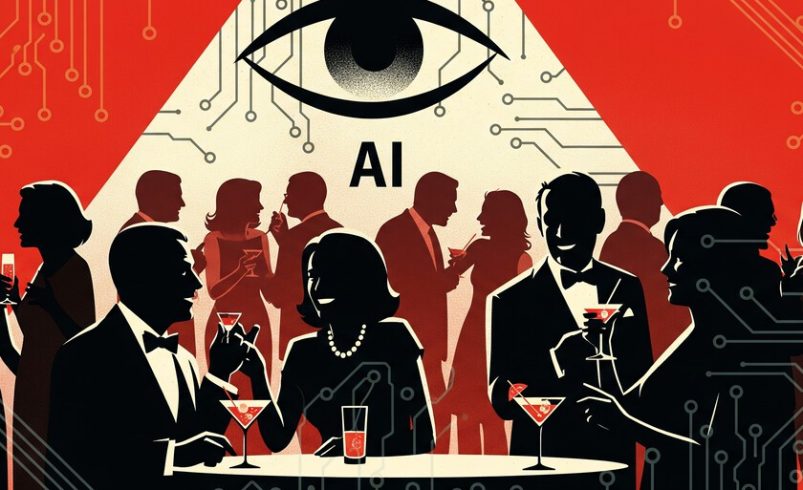

En una mansión con miras a Golden Gate, la élite de la inteligencia artificial se reunió el domingo pasado para discutir un tema inquietante: el fin de la

En una mansión con miras a Golden Gate, la élite de la inteligencia artificial se reunió el domingo pasado para discutir un tema inquietante: el fin de la

En una mansión con miras a Golden Gate, la élite de la inteligencia artificial se reunió el domingo pasado para discutir un tema inquietante: el fin de la humanidad y lo que vendrá más tarde. Entre las gafas (sin alcohol), sus alrededor de 100 asistentes, entre los cuales había filósofos, empresarios e investigadores, imaginaron un futuro en el que los humanos ya no existían, sino una inteligencia creada por nosotros. ¿Cómo debería ser nuestro sucesor?

El fin del fin del mundo. El evento que hemos conocido a través de Este informe por cable Se llamaba «sucesor digno» y tenía como objetivo discutir con precisión sobre eso: definir un «sucesor de la altura» para cuando la humanidad ya no existe. Esta idea está relacionada con la creación de un Inteligencia artificial general o AGIpor su acrónimo en inglés. Un concepto (por el momento) de superinteligencia que superaría al ser humano en todas las facetas del conocimiento, tan bien que, en palabras de Daniel Faggella, anfitriona de la fiesta: «Con placer que ella (no humanidad) determina el camino futuro de la vida misma».

Quien asistió. El primero: ¿Quién es este tipo y por qué deberíamos escucharlo? Faggella es la fundadora de Emerj Artificial Intelligence Research, una firma de consultoría y análisis de IA. En 2016 escribió en TechCrunch Sobre los riesgos de la IA y actualmente se centra en difundir el enfoque moral y filosófico, específicamente la creación de este «sucesivo digno» una idea que había estado flotando durante mucho tiempo. Según la cuenta En LinkedInha estado contactando a diferentes personalidades relevantes de la industria, dos años después, para celebrar esta reunión.

En la fiesta se escucharon tres documentos de la mano de Ginevra DavisEscritor de Nueva York, el filósofo Michael Edward Johnson y el anfitrión en sí. La lista completa de invitados no ha trascendido, pero Faggella se supone Que los fundadores de compañías de IA asistieron con valores de hasta 5,000 millones de dólares, personas de los laboratorios que están investigando para crear un AGI y algunos de los filósofos y pensadores más importantes del sector.

La superinteligencia que terminará con todo. En palabras de Faggella: «Los grandes laboratorios saben que AGI probablemente terminará con la humanidad, pero no hable de ello porque los incentivos no lo permiten». Suena como una teoría de la conspiración, pero no es el primero en advertir de algo así. Hace una década, Bill Gates nos dijo Deberíamos temer la IA. Poco después El almizcle exigió la regulación Para mitigar los peligros de lo que estaba por venir. Más recientemente, los diferentes expertos de IA firmaron Un mensaje que alertó el «riesgo de extinguir por la IA». Operai también pensó en Los riesgos del AGI. Incluso se habla de que sus declaraciones sobre la creación de un agi habrían sido La razón del despido sólido de Altman meses después.

Lo que es verdad en todo esto. No podemos saberlo con certeza, pero sí sabemos que la mayoría de los argumentos sobre la inminencia del agi Y sus riesgos se basan en opiniones y especulaciones, no en evidencia empírica o avances concretos. Por ejemplo, investigaciones recientes han demostrado que los sistemas actuales Todavía fallan en las tareas de razonamiento básicolo que contradice la idea de una superinteligencia a corto plazo. Además, hay indicios de que La IA generativa podría estar cerca de su techo. Tampoco hay consenso entre los expertos. Hay detractores que Lo consideran ridículoPero, por supuesto, es menos «viralizable» que decir que la IA nos extinguirá.

Y lo más importante: no podemos ignorar el hecho de que aquellos que hacen estas declaraciones son empresarios Como Altmany el El negocio es muy caro Y necesitas financiar. Agite the Loop que insiste en la inminente llegada del AGI podría ser una forma de recaudar más dinero para sus empresas.

Lo que dejaremos cuando desaparezcamos. El tema central de la fiesta no era tanto cómo se extinguirá la humanidad (parece que esto se da por sentado), sino qué tipo de inteligencia deberíamos crear para hacer de nuestro sucesor. Los asistentes escucharon presentaciones que giraban en torno a los valores y capacidades que esta nueva inteligencia superior debería tener. Para Faggella, la humanidad tiene la responsabilidad de diseñar un sucesor que sea consciente y capaz de evolucionar.

El filósofo Michael Edward Johnson destacó los restos de crear una IA consciente más allá de la posible extinción: «corremos el riesgo de esclavizar algo que pueda sufrir o confiar en algo en lo que no se puede confiar», dijo durante su presentación. En lugar de obligar a la IA a obedecer, propuso una educación conjunta de humanos e IAS para «seguir el bien», sea lo que sea. En resumen, un interesante Debate desde el punto de vista ético y filosóficoPero con poco ancla en realidad. Al menos por el momento.

Imagen de portada | Géminis

En | El arma secreta de la industria de la moda en China: esta startup utiliza IA para predecir la próxima tendencia